KI-Coverversionen – jetzt wird’s richtig wild

- Marcel

- Musikproduktion, Software

- Mai 05, 2023

- ai, ki, musikindustrie

AI/KI kann zeichnen, Texte verfassen, Texte verbessern und sogar in einem gewissen Maße programmieren. KI kann aber tatsächlich sogar singen. Und zwar kann KI mittlerweile richtig gut Coverversionen bekannter Songs erstellen. So ist es möglich, dass Kurt Cobain wieder auferstanden ist und Song 2 von Blur singt. Oder Chester Bennington von Linkin Park singt einen Song von Green Day.

Wie üblich ist das AI-Cover bei TikTok richtig groß geworden. Das bekannteste AI-Stück ist aktuell wohl die „Kooperation“ zwischen Kanye West und The Weekend. Die beiden haben nie einen Song zusammen aufgenommen, aber es gibt einen gemeinsamen Song mit denen. Dieser wurde komplett über KI realisiert. Aber, wie gesagt, ich möchte viel lieber über Coverversionen sprechen. Bei den ganzen Videoplattformen gibt es nun nämlich haufenweise Covers. Diese Covers zeichnen sich dadurch aus, dass jemand, der vor Jahren gestorben ist, einen Song singen kann, der jetzt erst raus kam. Oder aber, dass jemand, der noch lebt den Song einer Band spielt, die es gar nicht mehr gibt. Freddy Mercury singt Yesterday von den Beatles? Kein Problem.

Wie macht man das denn genau?

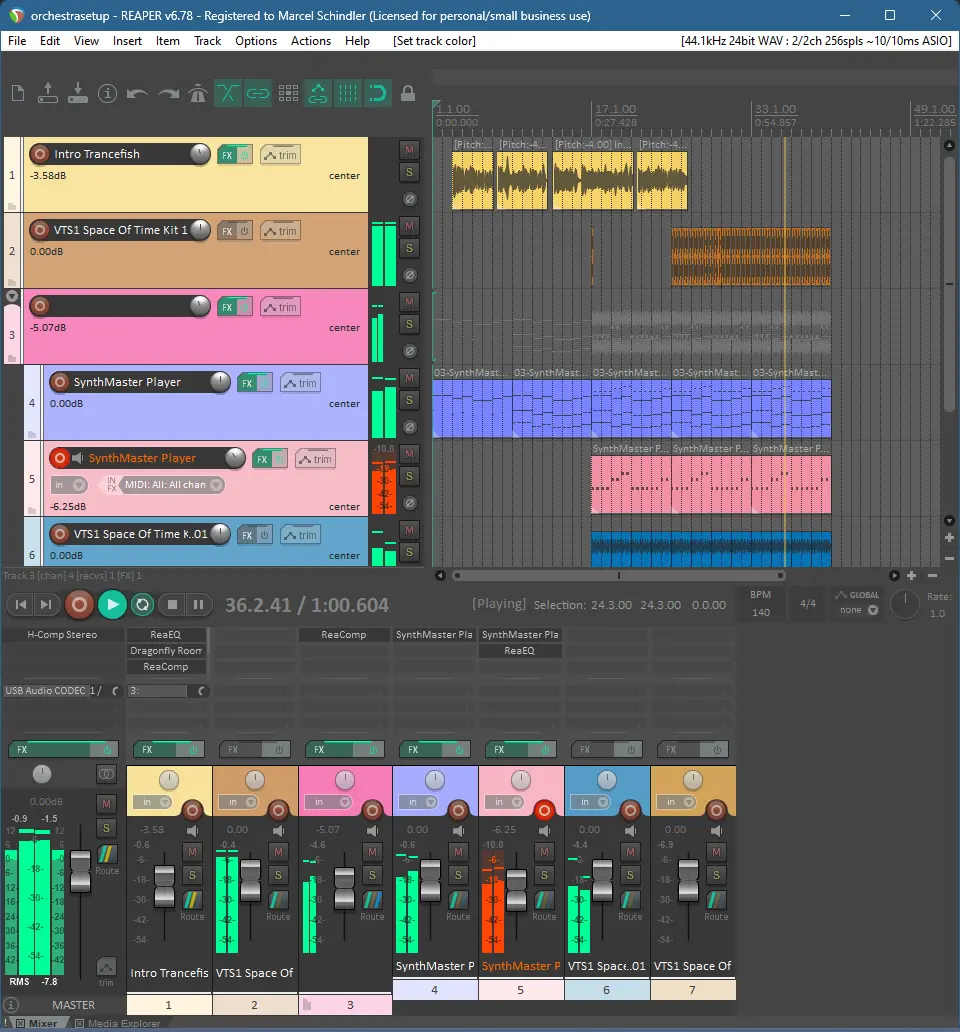

Eine Anleitung dafür gibt’s bei Youtube unter diesem Link. Es reicht im Grunde genommen schon, mit Spleeter die Gesangs- und Musikspur zu trennen und die Vocals dann hier per Skripte umwandeln zu lassen.

Und wo sind jetzt die Gefahren?

Einerseits ist es moralisch natürlich schwierig, tote Künstler neue Songs singen zu lassen. Diese Leute haben Familien, die nicht immer wieder an diesen Schicksalsschlag erinnert werden möchten. Mit dem bisherigen Werk des Künstlers klar zu kommen ist sicherlich etwas, was man erlernen kann. Abgesehen davon kriegt die Familie vielleicht sogar die Verwertungsrechte, die als Sicherheit vom Künstler gesehen werden könnten, denn die Familie ist versorgt.

Ein weiteres Feature ist, dass es sicherlich schon sehr cool ist, Nirvana Songs von den Foo Fighters singen zu lassen oder halt umgekehrt. Schwierig ist es aber spätestens dann, wenn – und jetzt kommt ein extremes Beispiel – jemand ein verfassungsfeindliches Lied von z.B. Herbert Grönemeyer singen lässt. In dem Moment muss der Künstler nachweisen können, dass er das gar nicht gesungen hat.

Urheberrecht

Wer ist der Urheber? Wenn ich einen Song schreibe, den selbst einsinge und dann aber per KI zum Beispiel Bryan Adams meinen Song singen lasse, begehe ich dann ein Verbrechen? Aktuell werden die gefakten Songs von Drake seitens der Labels eingestampft. Aber mit welchem Recht eigentlich? Es steht drauf, dass der Song von Drake ist, aber tatsächlich stammt der Song von jemand anderem, der eine KI benutzt hat, um Drake zu simulieren. Ich frage mich halt wirklich, ob das überhaupt erlaubt ist.

Fazit – vorläufig

KI in der Musik wühlt so einiges auf. Die Zeiten sind un-fass-bar spannend. Noch sehe ich immer keine Gefahr für Musiker an sich, aber ich bin mir sicher, dass neuere Songs definitiv nicht mehr unbedingt die besten Sänger:innen brauchen, sondern nur noch jemanden, der gute KI-Voices in seiner „Samplebibliothek“ hat.