AI: Das Damoklesschwert über allem, was Bürokräfte und Künstler so tun. AI kann besser programmieren als ich. AI kann bessere Musik machen als ich. AI macht bessere Fotos. AI macht bessere Filme. AI schreibt bessere Texte. AI ist effektiver als jeder von uns. AI macht uns alle steinreich und wir müssen nie wieder hart arbeiten.

Im Kern ist es das, was uns die Marketing-Menschen und CEOs dieser Welt auf LinkedIn erzählen wollen. AI verändert die Welt zum Besseren. Das ist die Kernaussage. AI wird viele Jobs unnötig machen und wer nicht mitspielt, hat keine Chance. Doch gehen wir mal los und prüfen genau, was denn dran ist, an dieser Geschichte.

Was genau ist AI?

Ich habe es in diversen Blogbeiträgen schon erklärt, wie AI tatsächlich funktioniert, aber ich gebe hier nochmal die absolute Kurzversion, die übrigens auch von einer AI geschrieben wurde.

Ein LLM (Large Language Model) ist im Grunde einfach nur die krasseste und auf Steroiden gepumpte Autokorrektur der Welt. Es "liest" deinen Text und rechnet blitzschnell aus, welches Wort statistisch gesehen als Nächstes folgen muss.

Das Setup dahinter sieht meistens so aus:

- Das "Modell": Das ist die eigentliche "Gehirn"-Datei. Ein riesiger Haufen Mathematik, der Wahrscheinlichkeiten und Text-Muster aus dem halben Internet gespeichert hat.

- Ollama: Das ist der Motor im Hintergrund. Ein kleines Tool, das dafür sorgt, dass du dieses fette "Modell" auf deinem eigenen PC überhaupt erst schnurrend zum Laufen bekommst.

- Das Frontend (webui): Da Ollama nur nackter Code und Terminal-Tipperei ist, klatscht man eine schicke Oberfläche drüber. Ein Frontend (wie Open WebUI) gibt dir einfach das bequeme WhatsApp-Style Chat-Fenster, das du am Ende bedienst.

Warum das null Komma null mit echter Intelligenz zu tun hat:

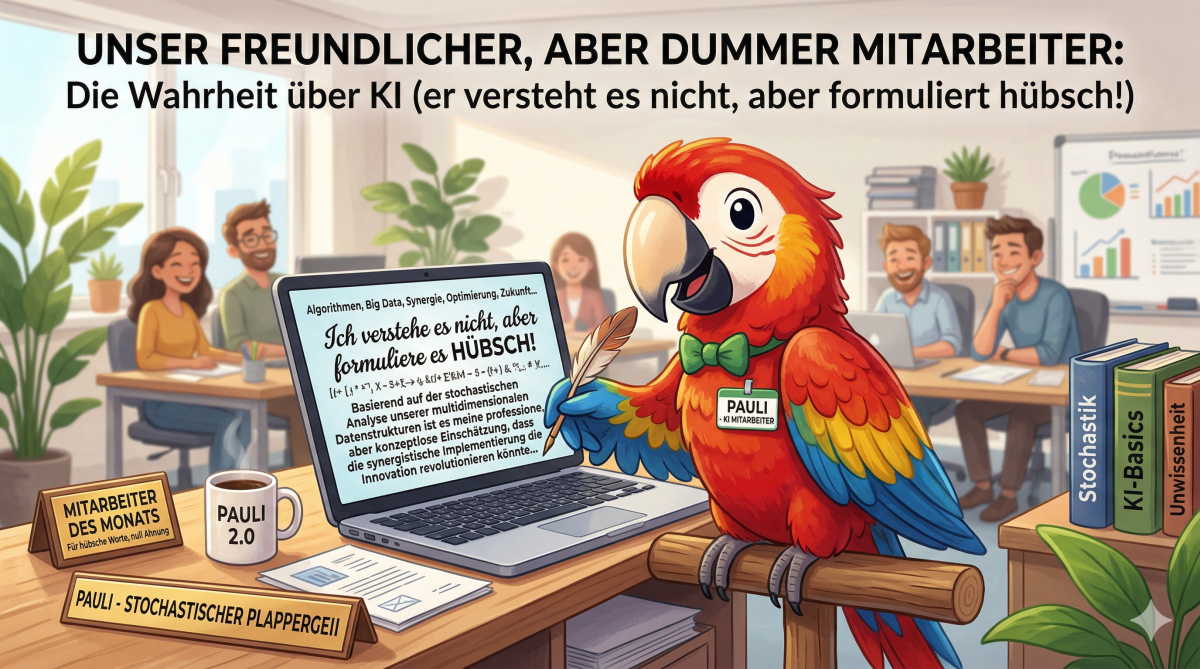

Dieses Ding denkt nicht nach und versteht kein einziges Wort von dem, was es da faselt. Es hat kein Bewusstsein, keine Gefühle und keinen gesunden Menschenverstand. Es ist letztendlich nur ein "stochastischer Papagei" – ein Programm, das blind Wörter aneinanderreiht, weil die Mathematik sagt: "Nach Wort A und B kommt meistens Wort C." Es ist pure Statistik, die sich extrem gut als echtes Wissen verkleidet, aber absolut nichts kapiert hat.

Fazit: Es ist völlig Hupe, ob du von Gemini, ChatGPT, Claude oder lokalen Modellen wie Gemma redest: Am Ende ist jedes LLM einfach nur eine gigantische Statistik-Datenbank, die blind die wahrscheinlichsten Wörter zu Sätzen zusammenklöppelt, ohne auch nur ansatzweise zu raffen, ob das inhaltlich überhaupt stimmt.

Firmen feuern wegen AI Leute

Hier wird's jetzt tricky und hier muss man auch wahnsinnig aufpassen. In den Medien wird gesagt, dass Oracle, Meta, Google und so weiter zigtausende Mitarbeiter entlassen, weil AI deren Jobs übernehmen soll. Das ist weichgespülter Mist und nicht wahr. AI kann diese Leute gar nicht ersetzen: Firmen, die das geglaubt haben, stehen jetzt vor unwartbarem Spaghetticode und niemand ist mehr da, der diese Fehler beheben kann.

Tatsächlich ist es für die Tech-Bros einfacher, zu behaupten, dass man diese Leute durch AI ersetzt, auch wenn dem nicht so ist. In der Coronazeit haben die Tech-Unternehmen hunderte und tausende von Leuten eingestellt. Corona hat dafür gesorgt, dass Netflix richtig profitabel wurde und die Infrastruktur von Social Media kam in der Zeit an ihre Grenzen. Mittlerweile sind wir aber fast wieder auf dem Niveau von vor-Corona angelangt. Die Userzahlen stagnieren, die Partyzeit ist vorbei. In der Coronazeit konnten Tech-Buden fast zinsfrei Milliarden Dollar ausleihen, weil Homeoffice zu der Zeit so wirkte, als ob es das ganz normale Gedöns ablösen würde.

Wie oben schon erwähnt: Die Firmen, die Mitarbeiter tatsächlich wegen KI gefeuert haben, haben jetzt ein Problem. Unwartbarer Drecks-Code, den Junior-Devs gar nicht mehr verstehen. Das beweisen auch Analysen von Gitclear. Coding on Copilot: 2023 Data Suggests Downward Pressure on Code Qualitytext

Wer also sein Personal durch LLMs ersetzt und das tatsächlich aufgrund der Tatsache tut, dass LLMs deren Arbeit erledigen, riskiert die eigene Unternehmensgesundheit, schlicht und einfach, weil LLMs das nicht können.

Umsetzung scheitert

IT-Projekte sind extremst komplizierte Dinge. Viele IT-Projekte scheitern schon in der Planungsphase, viele andere scheitern in der Umsetzung und so manches Projekt wird durchgezogen, obwohl jede beteiligte Person weiß, dass man da Müll fabriziert hat. Ich will gar nicht in Richtung Duke Nukem gucken, aber das Spiel ist ein Paradebeispiel für echtes Scheitern. Zu viele gute Ideen, die dann nicht mehr wirtschaftlich waren und am Ende kam ein durchschnittliches Spiel heraus.

Man sollte meinen, dass sich das mit AI verbessert haben könnte. Problem ist nur, dass es das nicht hat: Projekte können nicht umgesetzt werden, weil niemand tief genug im Thema steckt, um jetzt auch noch der AI zu vermitteln, was eigentlich umgesetzt werden soll. Tatsächlich funktionieren Projekte noch immer besser, wenn man sich mit anderen Menschen austauscht, die andere Standpunkte vertreten und so neue Impulse liefern.

Auch will natürlich niemand die Verantwortung übernehmen, für etwas, das von der KI umgesetzt wurde. Wenn ich Fehler in eine Software einbaue, dann bin ich selbst in der Lage, diese Fehler zu beheben. Dafür werde ich bezahlt. Ich bin aber nicht dafür verantwortlich, den Spaghetticode der AI zu verstehen. Auch wenn ich das als Projektleiter für das AI-Projekt wahrscheinlich wäre.

Ein großer Posten für das Scheitern ist übrigens mangelnde Datenqualität. Wer einmal schon Shops gemacht hat, wird das Problem kennen. Die meisten Produktdaten in Unternehmen sind absolut chaotisch sortiert. Es gibt keine filterbaren Artikeleigenschaften. Es ist nicht klar, ob Artikel in Kategorien gedacht werden können und wirklich niemand weiß alles, was man den Entwicklern an die Hand geben könnte.

Gute Entwickler/Projektmanager fragen nach und organisieren die Daten neu. KI tut das auch, denkt aber zu sehr technisch und zu wenig praxisbezogen. Natürlich streben wir alle eine Datenbanknormalisierung an, aber tatsächlich ist das nicht immer die praktischste Lösung.

Außerdem neigen gerade fachfremde Personen dazu, AI überzubewerten. Es ist und bleibt ein Tool und ich zitiere nochmal den Satz von oben:

Es ist pure Statistik, die sich extrem gut als echtes Wissen verkleidet, aber absolut nichts kapiert hat.

Du hast ein KMU? Gut! Du willst KI nutzen? Auch gut, ABER...

KI angucken und gar nicht reagieren, die Technik ignorieren? Das ist falsch. Das ist in etwa so schlau, wie das Ignorieren des Internets allgemein. Oder von Elektromobilität. Oder von LED anstatt klassischer Gas-Glühbirne. Aber du musst realistische Ziele haben und vor allem, „get your shit together“, wie der Franzose sagt. AI wird dir die Katalogisierung deiner Produktdaten nicht abnehmen. Aber AI kann dir helfen, aus drögen Eckdaten informative, verkaufsfördernde Produkttexte zu generieren, die auch noch fachbezogen sind. Du verstößt nicht einmal gegen die DSGVO, wenn du unpersönliche Produktdaten per Gemini in verständliche Daten umwandelst.

Wichtig ist, immer genau zu überlegen, wofür man KI einsetzen will. Ein Dienst, der per API ChatGPT dauerbefeuert, dann bei Gemini etwas ausformuliert und ein Bild erzeugt, danach bei Elevenlabs eine Sprachausgabe zaubert, verballert Token ohne Ende. Und Token kosten Geld. Viel Geld.

Lokale KI?

Tatsächlich hat lokale KI gigantische Vorteile für ein Unternehmen. Du investierst ein einziges Mal viel Geld in einen fetten Gaming-PC mit einer großen Grafikkarte, viel RAM und einer großen SSD. Das reicht. Auf dem installierst du dann Pinokio. Mit Pinokio kannst du dann LLMs, Sprachsynthese, Videogenerierung und so weiter auf deinem eigenen Computer nutzen. Über interne VPN-Verbindungen kannst du deine Website an solche Systeme anbinden und im Worst Case einfach den Gaming-PC ausschalten.

So etwas einzurichten, ist aber nicht der Job von dem Neffen, der sich mit Computern auskennt

Fazit

Künstliche Intelligenz ist kein Selbstzweck, sondern ein mächtiges, aber unstrukturiertes Werkzeug. Der wahre ROI entsteht nicht durch die Implementierung der neuesten Black-Box-Funktion, sondern durch die chirurgische Verbesserung der eigenen Geschäftsprozesse und die Bereinigung der Datenarchitektur. Bevor Du horrende Summen in KI investierst, frag dich: Sind unsere Fundamente – unsere Prozesse und Daten – überhaupt stabil genug, um dieses Hochleistungswerkzeug optimal zu nutzen? Nur mit dieser tiefgreifenden Selbstreflexion ist die KI kein Kostenfaktor, sondern ein echter Wettbewerbsvorteil.